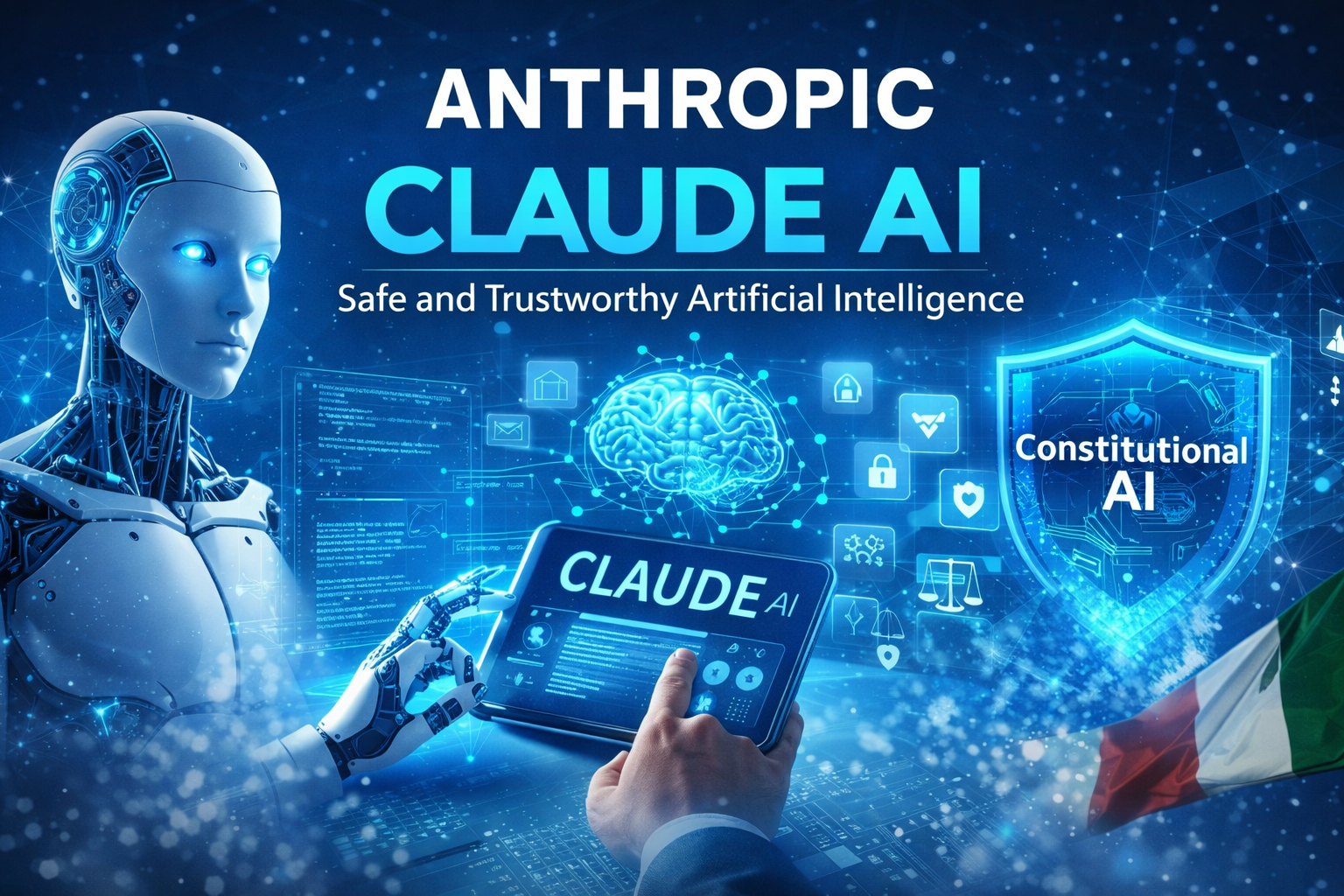

आर्टिफिशियल इंटेलिजेंस की दुनिया में तेजी से उभर रही कंपनी Anthropic एक बार फिर चर्चा में है। AI से जुड़े जोखिमों और जिम्मेदारी को लेकर बढ़ती वैश्विक चिंताओं के बीच, Anthropic खुद को एक ऐसी कंपनी के रूप में स्थापित कर रही है जो सुरक्षित, भरोसेमंद और इंसानों के मूल्यों के अनुरूप AI सिस्टम विकसित करने पर जोर देती है।

AI सुरक्षा को केंद्र में रखकर बना Anthropic

Anthropic की स्थापना साल 2021 में की गई थी। कंपनी के संस्थापक Dario Amodei और Daniela Amodei पहले OpenAI से जुड़े रह चुके हैं। Anthropic की सोच शुरू से ही अलग रही है—जहां ज्यादातर कंपनियां AI की क्षमता बढ़ाने पर ध्यान देती हैं, वहीं Anthropic AI Safety First अप्रोच पर काम करती है।

Constitutional AI: Anthropic की खास पहचान

Anthropic ने “Constitutional AI” नाम की एक अनोखी तकनीक विकसित की है। इस मॉडल में AI को ट्रेन करते समय पहले से तय किए गए नैतिक नियमों और मूल सिद्धांतों का पालन कराया जाता है, ताकि वह हानिकारक, भ्रामक या असुरक्षित जवाब देने से बच सके।

कंपनी का मानना है कि भविष्य का AI तभी उपयोगी होगा जब वह इंसानों के हित में काम करे।

Claude AI ने बढ़ाई Anthropic की ताकत

Anthropic का प्रमुख AI मॉडल Claude आज ChatGPT का एक मजबूत विकल्प माना जाता है। Claude को खास तौर पर:

- लंबे डॉक्यूमेंट समझने

- रिसर्च और एनालिसिस

- कोडिंग और टेक्निकल टास्क

- बिजनेस और एंटरप्राइज उपयोग

के लिए डिजाइन किया गया है। Claude की खासियत इसकी लॉन्ग-कॉन्टेक्स्ट समझ और संतुलित जवाब देने की क्षमता है।

Amazon और Google का भरोसा

Anthropic को उस वक्त बड़ा समर्थन मिला जब Amazon और Google जैसी दिग्गज टेक कंपनियों ने इसमें मल्टी-बिलियन डॉलर का निवेश किया। इससे साफ है कि AI इंडस्ट्री में सुरक्षित और जिम्मेदार टेक्नोलॉजी की मांग तेजी से बढ़ रही है।

विशेषज्ञों का मानना है कि Anthropic का मॉडल आने वाले समय में enterprise AI, government use-cases और regulated industries के लिए अहम साबित हो सकता है।

AI के भविष्य में Anthropic की भूमिका

जैसे-जैसे AI का इस्तेमाल शिक्षा, स्वास्थ्य, मीडिया और सरकारी सेवाओं में बढ़ रहा है, वैसे-वैसे इसके दुरुपयोग की आशंका भी सामने आ रही है। Anthropic इस खतरे को कम करने की दिशा में काम कर रही है।

कंपनी का लक्ष्य सिर्फ शक्तिशाली AI बनाना नहीं, बल्कि ऐसा AI तैयार करना है जिस पर समाज भरोसा कर सके।

Anthropic एक अमेरिकी AI research company है, जो safe, reliable और aligned artificial intelligence बनाने पर फोकस करती है।

🔹 Quick Facts

- Founded: 2021

- Founders: Dario Amodei, Daniela Amodei (ex-OpenAI team)

- HQ: San Francisco, USA

- Flagship AI: Claude (Claude 2, Claude 3, Claude 3.5)

🔹 Anthropic क्यों अलग है?

- 🛡️ AI Safety First: “Constitutional AI” approach—AI को साफ नियमों/values के साथ ट्रेन करना

- 🧠 Claude AI: Strong reasoning, long documents समझने में expert

- 📄 Long Context: बड़े PDFs, reports, codebases को आसानी से analyze करता है

- 🔒 Enterprise Friendly: Privacy और compliance पर ज़ोर

🔹 Claude AI का इस्तेमाल कहाँ होता है?

- Content writing & summarization

- Coding & debugging

- Research & data analysis

- Customer support automation

🔹 Big Partnerships

- Amazon और Google ने Anthropic में multi-billion dollar investments की हैं ☁️ assertively backing Claude.